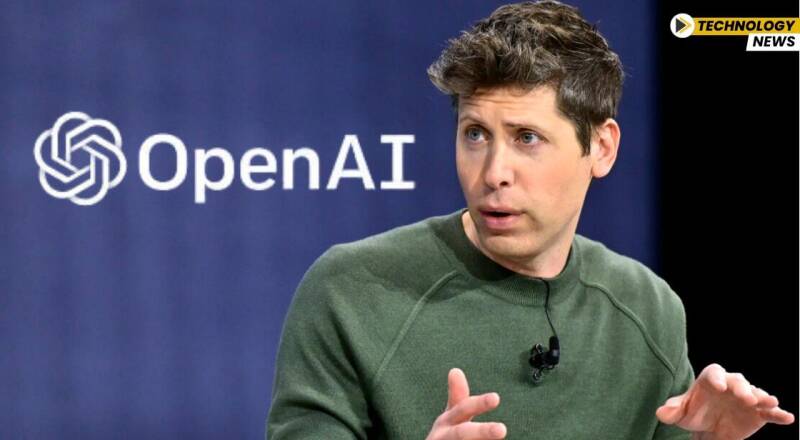

Sam Altman pose des limites claires à l’usage militaire de l’IA tout en poursuivant les négociations avec le Pentagone, un affrontement stratégique qui pourrait redéfinir les règles du jeu pour toute l’industrie technologique.

Par Sahby Mehalla

Le directeur général d’OpenAI, Sam Altman, a indiqué dans une note interne que son entreprise appliquerait les mêmes limites éthiques que celles qui ont provoqué un bras de fer majeur entre Anthropic et le Pentagone, excluant toute utilisation de l’intelligence artificielle pour la surveillance de masse ou les armes létales autonomes.

Altman souligne que l’enjeu dépasse désormais le différend entre Anthropic et le département américain de la Défense. Selon lui, il s’agit d’une question structurante pour l’ensemble de l’industrie de l’IA, appelant à clarifier une position commune sur les usages gouvernementaux de ces technologies.

Le dirigeant rappelle que son groupe défend depuis longtemps le principe d’un contrôle humain dans les décisions automatisées à fort impact et refuse que ses modèles soient employés pour des systèmes offensifs autonomes ou des dispositifs de surveillance intérieure à grande échelle.

Cette prise de position intervient alors que le Pentagone cherche une alternative au modèle Claude d’Anthropic, premier système intégré dans ses environnements les plus sensibles. Si des acteurs majeurs comme Google adoptaient les mêmes restrictions, les efforts du ministère de la Défense pourraient se heurter à des obstacles considérables.

Malgré cette solidarité affichée sur les principes, Sam Altman n’exclut pas un accord avec l’armée américaine. Il affirme vouloir trouver un cadre contractuel permettant le déploiement de ChatGPT dans des environnements classifiés, à condition que l’utilisation reste conforme aux lois et aux garde-fous définis par OpenAI.

ChatGPT est déjà accessible dans les systèmes militaires non classifiés et les discussions pour une extension vers des réseaux sécurisés se sont accélérées dans le contexte du conflit entre le Pentagone et Anthropic. L’armée exige toutefois que les fournisseurs acceptent une clause autorisant l’usage de leurs modèles pour « toutes les finalités légales », une formulation rejetée par Anthropic car jugée incompatible avec ses propres restrictions.

Le groupe d’Elon Musk, xAI, aurait accepté cette condition, mais son modèle Grok n’est pas considéré comme un remplaçant direct de Claude.

OpenAI propose plusieurs mécanismes pour faire respecter ses lignes rouges, notamment la possibilité de renforcer en continu ses systèmes de sécurité à partir des retours d’expérience opérationnels, la présence de chercheurs habilités secret-défense chargés de surveiller les usages et l’obligation de maintenir les modèles dans des infrastructures cloud plutôt que sur des systèmes embarqués comme des armes autonomes.

Ces propositions pourraient néanmoins susciter la même résistance que celle rencontrée par Anthropic. Le Pentagone refuse qu’une entreprise privée impose des contraintes opérationnelles à des missions jugées critiques pour la sécurité nationale, en particulier dans le contexte de la compétition technologique avec la Chine.

Le climat s’est encore tendu après que le directeur d’Anthropic, Dario Amodei, a maintenu ses exigences. Des employés d’OpenAI et de Google ont signé une lettre appelant leurs dirigeants à résister aux pressions du département de la Défense. Dans le même temps, le responsable des négociations côté Pentagone a vivement critiqué Amodei, l’accusant de mettre en danger la sécurité nationale.

Ancien collègue de Sam Altman chez OpenAI, Dario Amodei est aujourd’hui l’un de ses principaux rivaux dans la course mondiale à l’IA.

Les responsables de la Défense affirment pour leur part ne pas envisager de surveillance de masse ni de déploiement rapide d’armes autonomes. Leur principale préoccupation concerne la capacité d’une entreprise privée à limiter l’usage de technologies jugées stratégiques par l’État.

Sam Altman indique que de nouvelles réunions sont prévues avec les équipes de sécurité d’OpenAI afin de déterminer la suite des négociations, précisant que l’objectif est de prendre la décision « juste », même si elle peut sembler moins favorable à court terme.

ÉCRIT PAR SAHBY MEHALLA

Ajouter un commentaire

Commentaires